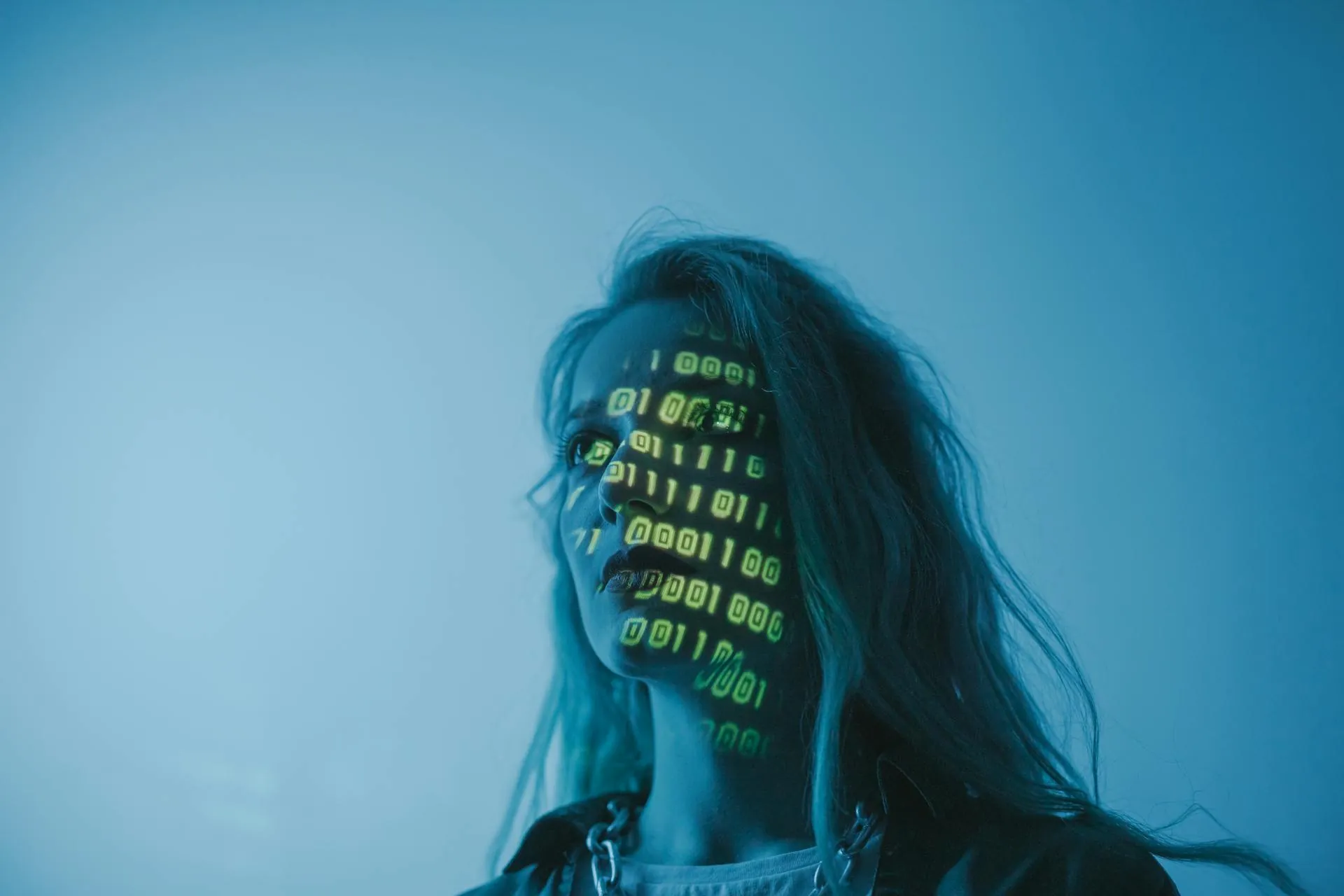

ثلاثة تحديات رئيسية في الذكاء الاصطناعي: خصوصية البيانات, التصيد الاحتيالي, والأمن

يجلب الذكاء الاصطناعي (AI) إمكانية تحويلية، حيث يقدم حلولاً مبتكرة لمشاكل معقدة. ومع ذلك، فإن هذه التطورات تأتي مع تحديات كبيرة، لا سيما في خصوصية...

يجلب الذكاء الاصطناعي (AI) إمكانية تحويلية، حيث يقدم حلولاً مبتكرة لمشاكل معقدة. ومع ذلك، فإن هذه التطورات تأتي مع تحديات كبيرة، لا سيما في خصوصية البيانات، التصيد الاحتيالي، والأمن. فهم هذه التحديات أمر بالغ الأهمية لتعزيز الثقة وضمان الاستفادة الكاملة من فوائد الذكاء الاصطناعي دون المساس بأمان المستخدم.

خصوصية البيانات: نعيش في عصر أصبحت فيه البيانات هي النفط الجديد. تعتمد أنظمة الذكاء الاصطناعي بشكل كبير على كميات هائلة من البيانات لتعمل بكفاءة. ومع ذلك، فإن جمع ومعالجة هذه البيانات يسبب مخاطر خطيرة على الخصوصية. يمكن أن يُساء استخدام المعلومات الشخصية القابلة للتعرف إذا لم تُحْمَ بشكل صحيح. تحتاج الشركات إلى تنفيذ أطر حوكمة بيانات صارمة، تضمن إخفاء هوية البيانات وتشفيرها مع الامتثال لتشريعات مثل اللائحة العامة لحماية البيانات (GDPR).

التصيد الاحتيالي: مع قدرة الذكاء الاصطناعي على تقليد السلوك البشري، يستغل القراصنة السيبرانيون ذلك لإنشاء هجمات تصيد أكثر تعقيدًا. يمكن للذكاء الاصطناعي إنشاء رسائل بريد إلكتروني تبدو أصلية، مما يخدع الأفراد لتقديم معلومات حساسة. يعتبر التوعية والتعليم أمرًا بالغ الأهمية للدفاع ضد مثل هذه التهديدات. كما يمكن استخدام أدوات الأمان المدعومة بالذكاء الاصطناعي في تحديد وتخفيف هذه الهجمات.

الأمن: مع تطور تقنيات الذكاء الاصطناعي، تتطور أيضًا الأساليب التي يستخدمها القراصنة. يمكن أن تكون أنظمة الذكاء الاصطناعي نفسها أهدافًا للهجمات. من الضروري تطوير بروتوكولات أمنية قوية لحماية نماذج الذكاء الاصطناعي من الهجمات العدائية. يمكن أن تساعد التقييمات الأمنية المنتظمة وتبني حلول الأمان المعتمدة على الذكاء الاصطناعي في حماية هذه الأنظمة بشكل فعال.

في الختام، بالرغم من أن الذكاء الاصطناعي يقدم فوائد عديدة، إلا أنه من الضروري معالجة التحديات المتعلقة بخصوصية البيانات، التصيد الاحتيالي، والأمن. من خلال فهم هذه المشاكل ومعالجتها بشكل استباقي، يمكننا إنشاء بيئة رقمية أكثر أمانًا، نستفيد فيها من قوة الذكاء الاصطناعي بشكل مسئول.

تحتاج مساعدة في مشروع ذكاء اصطناعي؟

سواء كنت تبحث عن تنفيذ حلول الذكاء الاصطناعي، أو تحتاج استشارة، أو تريد استكشاف كيف يمكن للذكاء الاصطناعي تحويل عملك، أنا هنا للمساعدة.

لنناقش مشروع الذكاء الاصطناعي الخاص بك ونستكشف الإمكانيات معاً.